Laptop Gaming AI Mỏng Nhẹ 2026: Hybrid AI Thay Đổi Trải Nghiệm Chơi Game

Laptop Gaming AI Mỏng Nhẹ 2026: Hybrid AI Thay Đổi Trải Nghiệm Chơi Game

Tác vụ AI cục bộ: Tại sao chạy LLM ngay trên máy lại quan trọng?

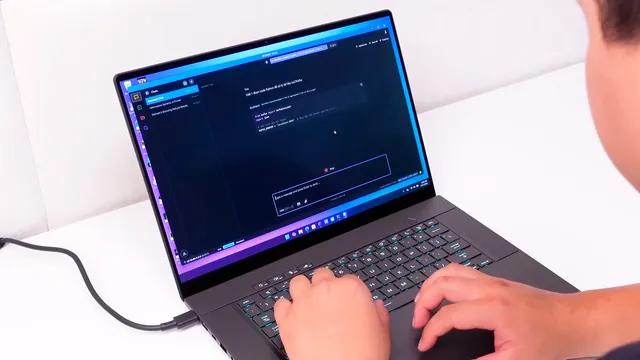

Khả năng chạy các mô hình ngôn ngữ lớn (LLM) cục bộ trực tiếp trên laptop là một trong những tiến bộ quan trọng nhất của Hybrid AI năm 2026. Với công cụ như LM Studio, người dùng có thể chạy DeepSeek R1, ChatGPT-OSS-20B hoặc Llama 3 ngay trên máy mà không cần kết nối internet — mang lại ba lợi ích lớn: bảo mật dữ liệu, không phụ thuộc vào kết nối mạng và giảm chi phí sử dụng API. Về bảo mật, dữ liệu của bạn không bao giờ rời khỏi thiết bị, điều đặc biệt quan trọng cho doanh nghiệp làm việc với thông tin nhạy cảm, dữ liệu tài chính hoặc hồ sơ khách hàng. Khi sử dụng các cloud AI services, dữ liệu phải upload lên server của nhà cung cấp, tạo ra rủi ro rò rỉ dù các hãng cam kết bảo mật. Với AI cục bộ, tất cả xử lý diễn ra ngay trên RAM và VRAM của máy — chỉ bạn mới có quyền truy cập.

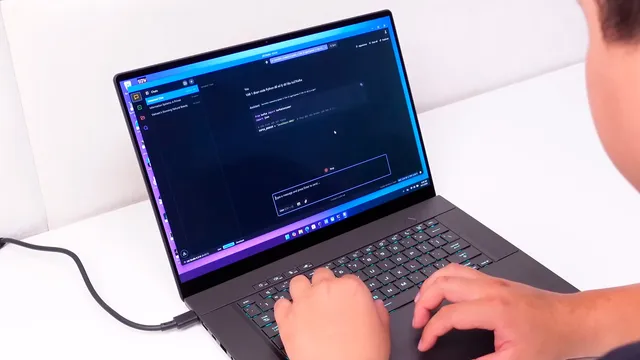

Về hiệu năng, AI cục bộ không bị giới hạn bởi tốc độ internet hay latency của server response. Một câu hỏi có thể được trả lời ngay lập tức trong 100-200ms so với 1-2 giây khi sử dụng ChatGPT web, và không lo bị throttling hoặc queue khi nhiều người cùng sử dụng cùng lúc. Điều này đặc biệt hữu ích cho lập trình viên cần hỏi gợi ý code liên tục, hoặc writer đang viết và cần brainstorm ý tưởng. Từ góc độ chi phí, chạy LLM cục bộ có thể tiết kiệm đáng kể so với sử dụng API trả phí. Một chatbot cục bộ chạy trên GPU RTX 5060 có thể xử lý hàng nghìn request mỗi ngày với chi phí điện năng chỉ khoảng 10.000đ, trong khi cùng số lượng request trên OpenAI API có thể tốn hàng triệu đồng. Tuy nhiên, cần lưu ý rằng các LLM cục bộ thường có kích thước nhỏ hơn (7B-20B parameters) so với các mô hình cloud (GPT-4 với 1.7T parameters), nên khả năng reasoning và giải quyết vấn đề phức tạp vẫn có hạn chế. Một hạn chế của AI cục bộ là cần hardware đủ mạnh để chạy mượt mà. Các LLM 7B parameters yêu cầu tối thiểu 8GB VRAM, trong khi LLM 20B cần khoảng 24GB VRAM — nghĩa là chỉ các dòng laptop có GPU RTX 5070 trở lên mới chạy được tốt. RAM hệ thống cũng đóng vai trò quan trọng, với tối thiểu 32GB cho các tác vụ AI nhẹ, 64GB trở lên cho các mô hình lớn hơn. Đây là lý do tại sao TUF A14 với RAM tối đa 64GB và Z13 với 128GB có lợi thế rõ rệt so với các dòng laptop gaming phổ thông chỉ có 16GB.

Công nghệ tản nhiệt và quản lý năng lượng trên laptop AI mỏng nhẹ

Thách thức lớn nhất khi tích hợp cả NPU và GPU mạnh vào thiết kế mỏng nhẹ là quản lý nhiệt. Năm 2026, các nhà sản xuất đã giải quyết bài toán này bằng nhiều công nghệ tản nhiệt tiên tiến kết hợp với giải pháp phần mềm thông minh. Công nghệ 0dB Ambient Cooling cho phép quạt dừng hoàn toàn khi xử lý tác vụ nhẹ như văn bản, web browsing hoặc xem video. NPU sẽ đảm nhận hầu hết các tác vụ nền này với mức tiêu thụ điện năng cực thấp (dưới 5W), giúp máy hoạt động hoàn toàn yên tĩnh và tiết kiệm pin. Khi nhiệt độ tăng lên hoặc người dùng mở game, quạt sẽ từ từ tăng tốc với độ ồn từ 0dB lên khoảng 32-35dB — mức vẫn chấp nhận được trong môi trường văn phòng. Hệ thống tản nhiệt vapor chamber kết hợp heatpipe đồng nhôm giúp phân tán nhiệt nhanh chóng từ CPU, GPU và NPU. Các dòng laptop cao cấp như Zephyrus G14 sử dụng liquid metal trên CPU thay vì thermal paste truyền thống, giúp giảm nhiệt độ khoảng 5-7°C trong khi tải nặng. Tấm tản nhiệt đồng với độ dày chỉ 0.1mm nhưng diện tích lớn giúp tăng hiệu suất tản nhiệt mà không làm tăng kích thước máy.

Về quản lý năng lượng, Hybrid AI cho phép hệ điều hành tự động chuyển đổi giữa các nguồn xử lý tùy theo tác vụ. Khi chạy văn bản, chỉ NPU và CPU core tiết kiệm điện hoạt động với mức tiêu thụ tổng khoảng 10-15W. Khi chơi game nhẹ, GPU RTX 5060 sẽ hoạt động ở mức 40-60W. Khi cần hiệu năng tối đa (render 3D, train AI), toàn bộ hệ thống có thể tiêu thụ lên đến 150-180W — nhưng chỉ trong thời gian ngắn trước khi thermal throttling giảm hiệu suất để bảo vệ phần cứng. Công nghệ Adaptive Sync trên màn hình OLED giúp tiết kiệm năng lượng bằng cách điều chỉnh tần số quét từ 48Hz đến 120Hz tùy theo nội dung hiển thị. Khi đọc văn bản, màn hình chạy ở 48Hz để tiết kiệm pin, khi chơi game thì tự động lên 120Hz để đảm bảo smoothness. Kết hợp với độ sáng tối đa 500 nits (nhưng tự động giảm xuống 200-300nits trong môi trường ít sáng), màn hình OLED không chỉ mang lại chất lượng hình ảnh xuất sắc mà còn giúp tối ưu thời lượng pin. Một lưu ý quan trọng cho người dùng laptop AI mỏng nhẹ là tránh sử dụng máy trên bề mặt mềm như giường, sofa hoặc chăn — điều này sẽ chặn các khe tản nhiệt và gây tăng nhiệt độ nhanh chóng. Nên sử dụng laptop stand hoặc pad tản nhiệt đặc biệt khi chơi game hoặc chạy tác vụ AI nặng trong thời gian dài, và đảm bảo quạt thoát nhiệt không bị che khuất bởi tay cầm hoặc các vật dụng khác.

Ứng dụng thực tế của Hybrid AI trong Gaming

Hybrid AI không chỉ cải thiện hiệu năng tổng thể mà còn tạo ra những trải nghiệm gaming hoàn toàn mới trên laptop mỏng nhẹ. Công nghệ NVIDIA DLSS 4 với AI Frame Generation sử dụng NPU để tạo ra các khung hình bổ sung giữa các khung thực tế, giúp tăng FPS đáng kể mà không giảm chất lượng hình ảnh. Đặc biệt với các tựa game AAA đòi hỏi đồ họa cao như Cyberpunk 2077 hay Alan Wake 2, người dùng có thể đạt 60-80 FPS ngay cả trên cấu hình RTX 5060 — mức trước đây chỉ có thể với GPU cao cấp hơn. Công nghệ Ray Reconstruction cũng được tối ưu hóa nhờ Hybrid AI, cho phép ánh sáng phản chiếu thực tế hơn trong khi vẫn giữ ổn định frame rate.

Bên cạnh cải thiện đồ họa, AI còn giúp tối ưu hóa game tự động. NVIDIA Game Ready Driver với AI tích hợp có thể học thói quen chơi game của người dùng và điều chỉnh các setting đồ họa phù hợp nhất với hardware hiện có. Nếu GPU đang quá tải, AI sẽ tự động giảm chất lượng shadow hoặc ambient occlusion để duy trì FPS ổn định. Ngược lại, khi hệ thống còn dư tài nguyên, AI sẽ tăng chất lượng texture và hiệu ứng lên mức tối đa. Điều này giúp người dùng không cần phải tùy chỉnh thủ công mỗi khi cài một tựa game mới. Một ứng dụng thú vị khác là AI-assisted gameplay — khả năng phân tích phong cách chơi và đưa ra gợi ý cải thiện. Ví dụ, trong game FPS, AI có thể phân tích recoil pattern và đề xuất cài đặt sensitivity phù hợp, hoặc trong game MOBA, AI có thể phân tích kỹ năng và đề xuất build item tối ưu cho champion mà người dùng thường chơi. Tuy nhiên, các tính năng này vẫn đang trong giai đoạn phát triển và chưa được tích hợp rộng rãi vào các game hiện tại.

Câu hỏi thường gặp

Hybrid AI khác gì so với AI truyền thống chỉ có NPU?

Hybrid AI kết hợp NPU xử lý tác vụ nền nhẹ với GPU mạnh cho tác vụ AI nặng, trong khi AI truyền thống chỉ dựa vào NPU và không đủ sức cho gaming hay tạo sinh nội dung.

Laptop AI 2026 có thể chạy Stable Diffusion offline không?

Có, các dòng laptop có GPU RTX 5060 trở lên với VRAM tối thiểu 8GB có thể chạy Stable Diffusion offline, nhưng tốc độ sẽ nhanh hơn với GPU RTX 5070/5080.

NPU 50 TOPS có đủ cho tác vụ AI hàng ngày không?

NPU 50 TOPS đủ cho các tác vụ AI nền như nhận diện giọng nói, Windows Studio Effects, nhưng không đủ cho training mô hình hay chạy LLM lớn — cần hỗ trợ từ GPU.

TUF A14 hay Zephyrus G14 phù hợp hơn cho designer?

Zephyrus G14 phù hợp hơn nhờ màn hình OLED 3K với độ phủ màu DCI-P3 và Delta E < 1, trong khi TUF A14 có màn hình IPS tiêu chuẩn hơn nhưng giá rẻ hơn.

Có cần nâng cấp RAM để chạy AI cục bộ không?

RAM 32GB là tối thiểu cho các tác vụ AI nhẹ, 64GB trở lên được khuyến nghị cho LLM 7B-20B parameters, và 128GB cần cho các mô hình lớn hơn hoặc multitasking nhiều app AI cùng lúc.

Khám Phá

Trải nghiệm hình ảnh chân thực từ laptop mỏng nhẹ cấu hình cao

Laptop Gaming AI Hybrid 2026: Khi NPU và GPU cùng định hình tương lai

Tìm hiểu Acer Aspire 7 - Laptop văn phòng mỏng nhẹ giá rẻ

Top 10 Laptop Chơi Liên Minh 2026: Hướng dẫn chọn cấu hình tối ưu

Đầu tư công nghệ – Cốt lõi thành công của trải nghiệm nhân viên